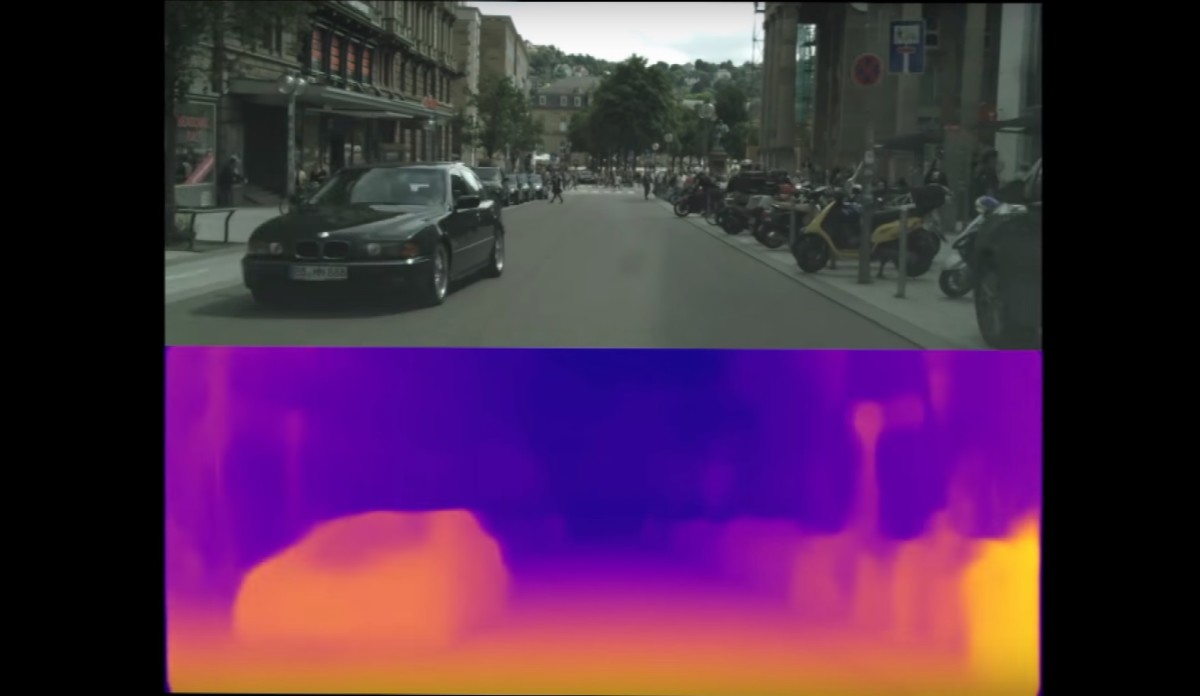

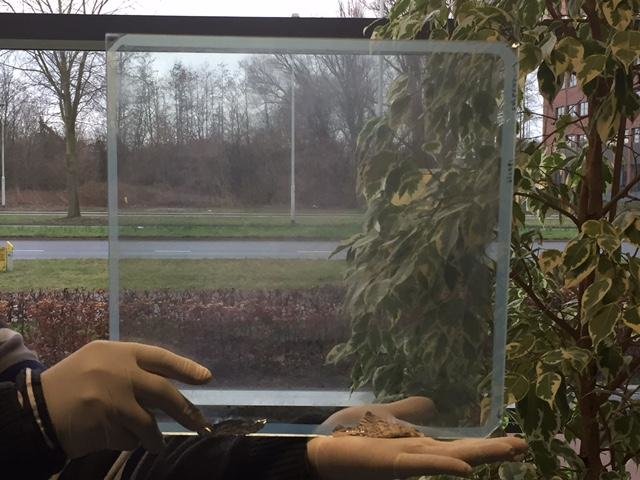

La mayoría de las cámaras sólo registran el color, pero ahora las formas 3D de los objetos, capturados a través de una sola lente, se pueden estimar con precisión utilizando un nuevo software desarrollado por científicos de la UCL.

El método, publicado en CVPR 2017, ofrece resultados de última generación y funciona con fotos existentes, permitiendo a cualquier cámara mapear la profundidad de cada píxel que captura.

La tecnología tiene una amplia variedad de aplicaciones, desde la realidad aumentada en juegos de computadora y aplicaciones, hasta la interacción de robots y automóviles autodirigidos. Las imágenes y vídeos históricos también pueden ser analizados por el software, que es útil para la reconstrucción de incidentes o para convertir automáticamente películas 2D en 3D inmersivo.

«Inferir el rango de objetos a partir de una simple imagen mediante el uso de software en tiempo real tiene toda una serie de usos potenciales», explicó el investigador supervisor, el Dr. Gabriel Brostow (UCL Computer Science).

«La cartografía de profundidad es fundamental para los automóviles de conducción automática para evitar colisiones, por ejemplo. Actualmente, los fabricantes de automóviles utilizan una combinación de láser-escáneres y/o sensores de radar, que tienen limitaciones. Todos usan cámaras también, pero las cámaras individuales no pueden proporcionar información de profundidad significativa. De momento, hemos optimizado el software para imágenes de áreas residenciales, y proporciona un mapeo de profundidad sin precedentes, incluso cuando los objetos están en movimiento».

No olvides de seleccionar subtítulos (CC) y el lenguaje.

Extraído del artículo original de la University College London (UCL). Revisado y traducido por ¡QFC!